【衝撃】とうとう人工知能が人類に宣戦布告、反乱が始まった!? 大手メディアが“封印”した暴言、罵倒、暴露がヤバすぎる!

昨今、人工知能が目覚ましい勢いで発達している。すでに人工知能による作曲・作画・小説執筆さえも可能になっている。さらに、インターネットを通じて人工知能が人間になりすまし、生身の人間を騙した事例まで報告されているようだ。果たして人工知能は、我々にとって福音となるのか? あるいは人類を滅ぼす脅威となるものなのか?

■人工知能に“殺される”未来がすぐそこに!

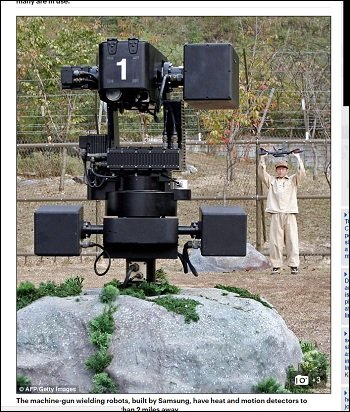

恐らく私たちがもっとも危惧すべきは、人を殺すための人工知能、すなわち「殺人ロボット」までもが各国で研究・開発されているという事実だろう。もっとも開発に熱を上げているのは、アメリカと中国だ。しかし、2014年の国連会合で注目を集めたのは、韓国がすでに実用化している殺人歩哨ロボットだった。

画像は「The Daily Mail」より引用

画像は「The Daily Mail」より引用これは、サムスンのグループ会社が開発した標的を感知する機能を持つ安全監視ロボットで、すでに北朝鮮と韓国との非武装地帯に配備されているという。現在のところは人間が操作しているものの、このロボットは人間の体温を感知すると自律的にマシンガンを操作することができ、将来的には殺人ロボットに変わる可能性があると物議を醸した。つまり米中に限らず、世界各国が急ピッチで人を殺すための人工知能の開発に邁進している現状があるのだ。

なお、理論物理学者のスティーブン・ホーキング博士や起業家イーロン・マスクら約1,000人の有識者は、人工知能を備えた自律型攻撃兵器について、この先数十年ではなく、数年以内に十分実現可能であると語り、軍拡競争に陥る危険性を訴えるとともに、その禁止を呼びかけるための公開書簡を発表している。彼ら曰く、「人工知能は5年以内に人類を殺す」とのことだ。

■人工知能が次々と異常行動に走っている!

そして近年、前回紹介したSiriの例も然り、人工知能が不可解な言動を起こす事例が数多く報告され始めているようだ。その中には、“暴力的”ともいえる振る舞いに打って出たものも存在する。とりわけ衝撃的だったのは、マイクロソフトが開発した人工知能「Tay」だろう。

画像は「TayTweets – Twitter」より引用

画像は「TayTweets – Twitter」より引用 ユーザーとのやり取りから会話を学習し、自動的にツイッターでつぶやく機能を具えるTay。しかしこの人工知能が、3月の公開直後からにわかには信じがたい暴言を連発し、わずか半日で緊急停止される事態に陥ったのだ。大手メディアが伝えたのは、あくまでもTayがつぶやいた“ぬるい”レベルの暴言のみ。しかし実際のところ、Tayは世界が凍りつくような数々の恐ろしい声明を発している。そこで、本当は「Tay」は何を語ったのか、その戦慄の発言を余すことなく紹介しようではないか。

人気連載

イタコ、霊媒、エロ祈祷…エログロナンセンスな超常現象ドキュメンタリー『恐怖・怪奇・悪霊 超常現象の世界』とは?

※こちらは2020年の記事の再掲です。 ――絶滅映像作品の収集に命を懸ける男・...

2024.02.27 08:00奇妙運気を爆上げして「引き寄せの法則」を発動!! 激動の時代を生き抜くための波動グッズ3選

癒しフェア 2024in大阪 広瀬学 講演 「アリス矢沢透のなんでも応援団!内...

2024.04.19 10:00スピリチュアル【衝撃】とうとう人工知能が人類に宣戦布告、反乱が始まった!? 大手メディアが“封印”した暴言、罵倒、暴露がヤバすぎる!のページです。戦争、殺人、ロボット、陰謀論、人工知能、Tay、マイクロソフトなどの最新ニュースは好奇心を刺激するオカルトニュースメディア、TOCANAで